عبر المسابقات والمنصات ومواقع التحقيق/التحقق، نقدم دليلاً على ما إذا كان المحتوى قد تم إنشاؤه بواسطة الذكاء الاصطناعي أو تم تغييره - إلى جانب آثار التلاعب وإشارات المصدر.

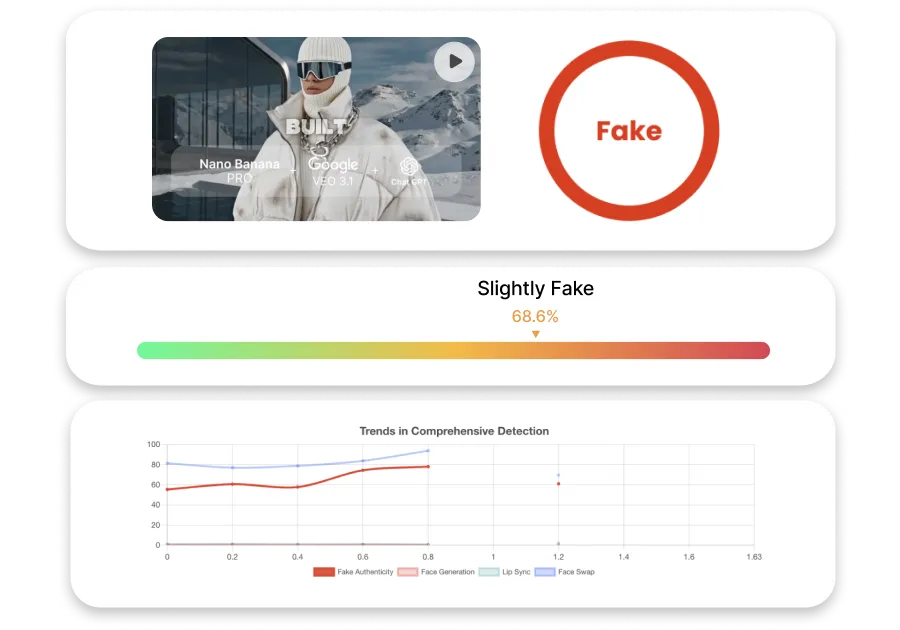

يحقق دقة اكتشاف تزيد عن 90% عبر أنواع التزييف العميق الرئيسية، بما في ذلك تبديل الوجه ومزامنة الشفاه والتلاعب بالذكاء الاصطناعي التوليدي.

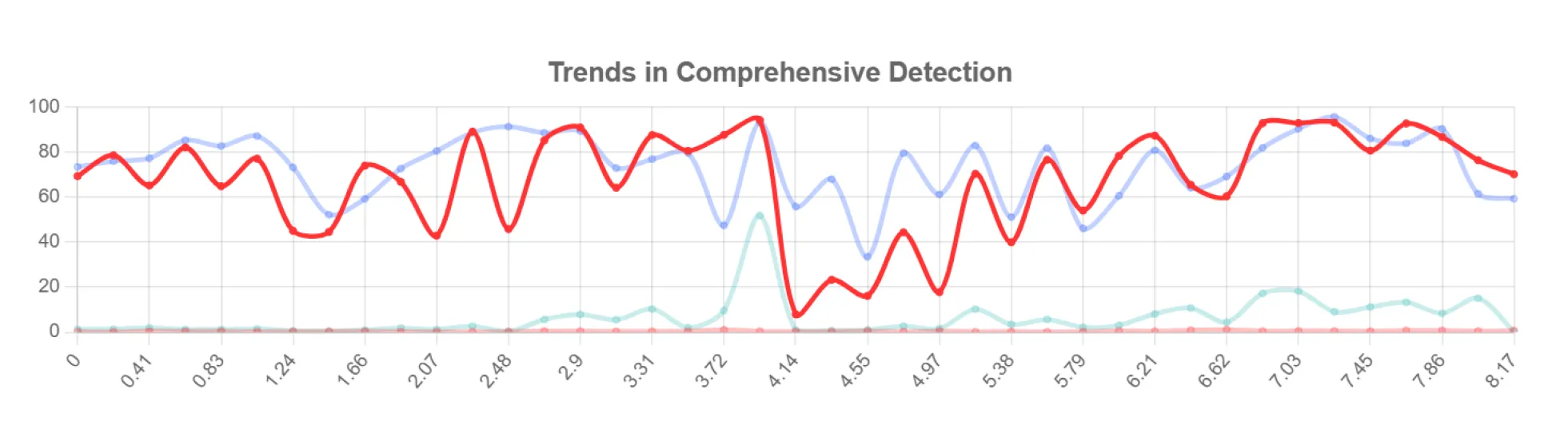

وضع علامة على القطاعات المشبوهة على المستوى الثاني/القطاع، مما يتيح التحقق السريع والقائم على الأدلة حتى في ظل الطلبات ذات الحجم الكبير.

تتم الترقية باستمرار باستخدام KoDF، وهي مجموعة بيانات واسعة النطاق للتزييف العميق، لتعزيز الأداء في ظروف العالم الحقيقي.

بدءًا من تحديثات التكنولوجيا ووصولاً إلى التعاون العام والمؤسساتي وتطبيقات الكشف عن الذكاء الاصطناعي المولدة، قمنا بجمع آخر الأخبار وحالات الاستخدام التي تتمحور حول أمثلة من العالم الحقيقي.

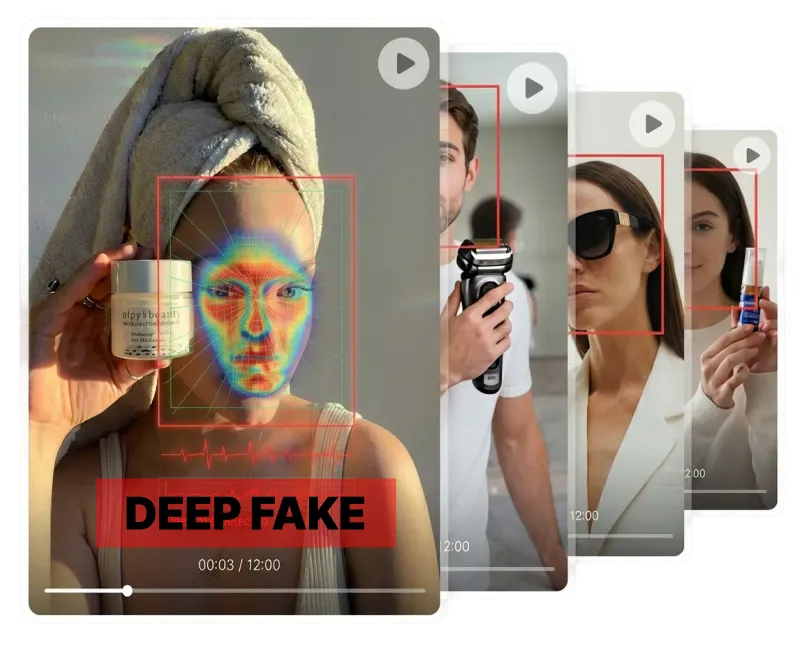

التزييف العميق هو عبارة عن وسائط اصطناعية يتم إنشاؤها أو التلاعب بها بواسطة الذكاء الاصطناعي لجعل مقاطع الفيديو أو الصوت أو الصور تبدو حقيقية. يتضمن تبديل الوجه، والتزييف العميق لمزامنة الشفاه، وتعديلات الذكاء الاصطناعي التوليدية، واستنساخ الصوت. يمكن أن تسبب تقنية Deepfakes ضررًا خطيرًا على الثقة والأمن، بما في ذلك المواد الإباحية العميقة وانتحال الشخصية والمعلومات الخاطئة.

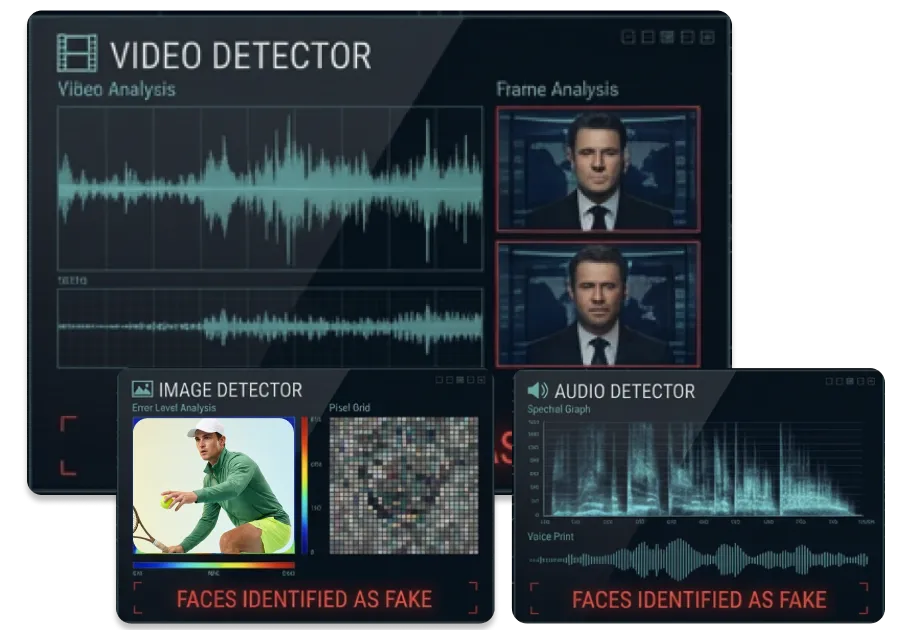

يقوم AI Detector بتحليل الفيديو والصوت والصور معًا لتحديد محتوى التزييف العميق. فهو يكتشف الأنواع الرئيسية مثل تبديل الوجه، والتزييف العميق لمزامنة الشفاه، والتلاعب بالذكاء الاصطناعي التوليدي، وانتحال الصوت. وهذا مفيد بشكل خاص للحالات التي تستهدف الأشخاص مثل حوادث التزييف العميق للكيبوب.

يستخدم AI Detector مسارًا متعدد الخطوات للذكاء الاصطناعي للعثور على آثار التلاعب وتحديد الأصالة. فهو يجمع بين التعلم الآلي/الكشف عن أنماط التعلم العميق، والمقارنة الأصلية/المرجعية، وتحليل ميزات الوجه/الصوت الدقيق. يتم وضع علامة على القطاعات المشبوهة على مستوى القطاع لدعم المراجعة القائمة على الأدلة.

يوفر AI Detector نتائج الأصالة بالإضافة إلى تقرير الأدلة. يتضمن التقرير الجداول الزمنية للقطاعات المشبوهة، وأنواع التلاعب، ونتائج التحليل اللازمة للتحقق. وقد تم تنسيقه للاستخدام الفوري في التحقيقات والمراجعات الداخلية والاستجابة للمخاطر.

يحقق AI Detector حاليًا دقة اكتشاف تزيد عن 90%. تتم ترقيته باستمرار للحفاظ على أداء مستقر عبر أنواع التزييف العميق الرئيسية. تتحسن الدقة بمرور الوقت من خلال البيانات المستمرة وتحديثات النماذج.

عادةً ما يقدم AI Detector نتائج الأصالة في غضون دقائق. يقوم بمعالجة الفيديو والصورة والصوت بسرعة لتقليل الوقت اللازم للتحقيق والتحقق. يتم تسليط الضوء على المقاطع المشبوهة على المستوى الثاني/القطاع لإجراء فحص سريع.

يركز AI Detector حاليًا على الكشف السريع وتقديم الأدلة بدلاً من الحظر المسبق. وبدلاً من إزالة المحتوى تلقائيًا، فإنه يوفر دليلاً واضحًا حتى تتمكن الأطراف المسؤولة من اتخاذ الإجراءات اللازمة. يمكن مناقشة السياسات التشغيلية وتكامل سير العمل وفقًا لاحتياجات النشر.

نعم. يمكن تزويد AI Detector بخيارات واجهة برمجة التطبيقات/التكامل لبيئات المؤسسات والمؤسسات. وهو يتناسب مع سير عمل التحقق أو المراقبة أو الأمان الحالي. تتم محاذاة نطاق التكامل وطريقة التكامل أثناء عملية الإعداد.

يعمل AI Detector وفقًا لسياسات أمان العملاء والخصوصية. يمكن تعديل معايير معالجة البيانات والاحتفاظ بها لتلبية متطلبات البيئة. تتوفر ضوابط الأمان على مستوى المؤسسات لعمليات النشر المؤسسية.

أرسل طلبك عبر زر [تطبيق الدعم المجاني لمدة شهر واحد] في هذه الصفحة. بعد مراجعة غرضك ونطاق التحليل، سيتصل بك ممثلنا لإبلاغك بالخطوات التالية. نحن ندعم طلبات التحقق عبر المؤسسات العامة والتعليم وبيئات الشركات.