コンテスト、プラットフォーム、調査/検証サイト全体で、コンテンツが AI によって生成されたものであるか改変されたものであるかの証拠を、操作の痕跡や来歴のシグナルとともに提供します。

顔の交換、リップシンク、生成 AI 操作など、主要なディープフェイク タイプ全体で 90% 以上の検出精度を達成します。

疑わしいセグメントに 2 番目/セグメント レベルでフラグを立て、大量のリクエストでも迅速かつ証拠に基づいた検証を可能にします。

大規模ディープフェイク データセットである KoDF を使用して継続的にアップグレードし、現実世界の状況でのパフォーマンスを強化します。

テクノロジーの最新情報から公共および機関のコラボレーション、生成 AI 検出アプリケーションまで、実例を中心とした最新ニュースとユースケースを集めました。

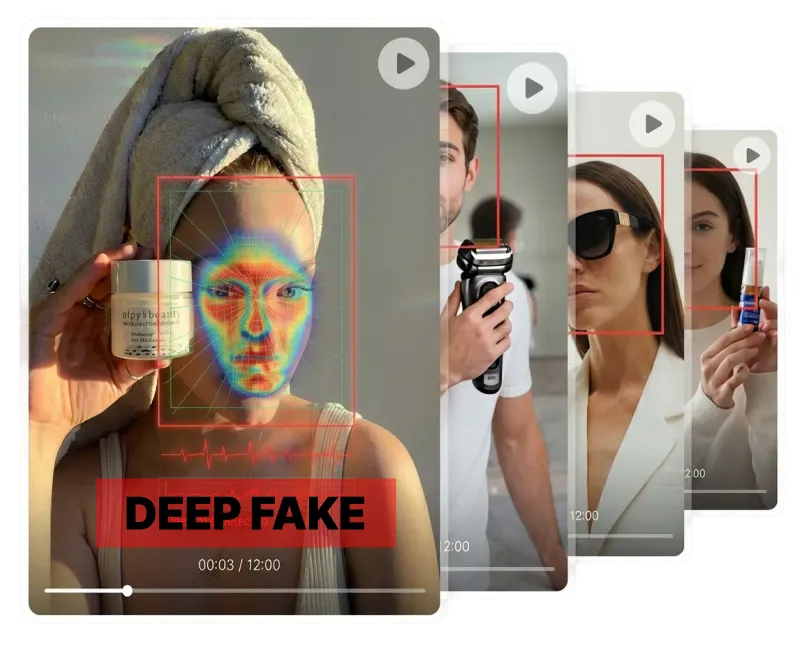

ディープフェイクは、ビデオ、音声、画像を本物のように見せるために AI によって作成または操作される合成メディアです。これには、顔の交換、リップシンクディープフェイク、生成 AI 編集、音声クローン作成が含まれます。ディープフェイクは、ディープフェイク ポルノ、なりすまし、誤った情報など、深刻な信頼とセキュリティへの被害を引き起こす可能性があります。

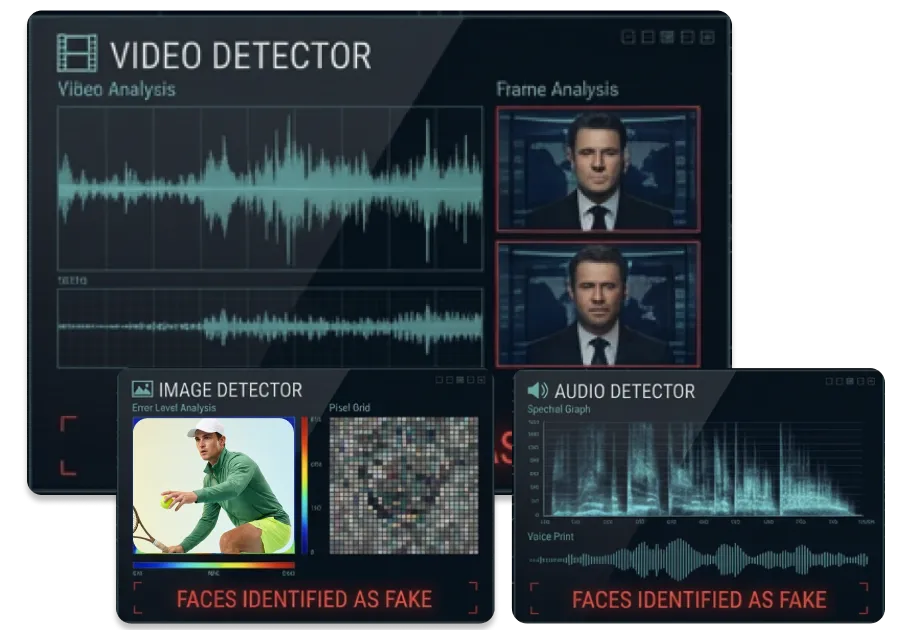

AI Detector はビデオ、音声、画像を一緒に分析してディープフェイク コンテンツを識別します。顔の交換、リップシンクディープフェイク、生成 AI 操作、音声なりすましなどの主要なタイプを検出します。これは、kpop ディープフェイク事件のような個人をターゲットにしたケースに特に役立ちます。

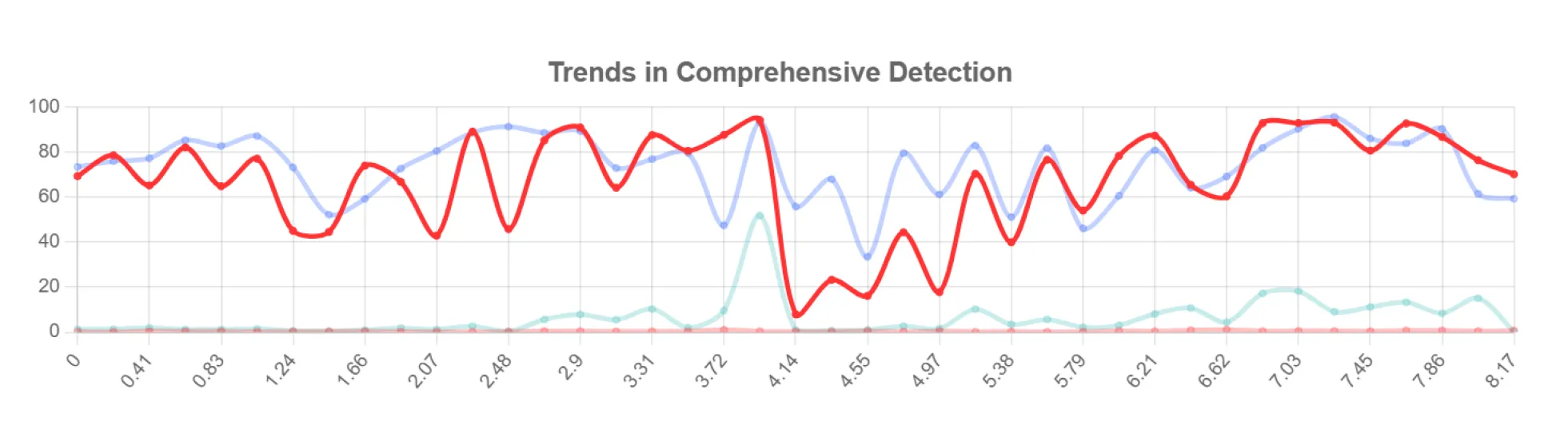

AI Detector は、マルチステップ AI パイプラインを使用して操作の痕跡を見つけ、信頼性を判断します。機械学習/深層学習パターン検出、オリジナル/リファレンス比較、および詳細な顔/音声特徴分析を組み合わせます。証拠に基づいたレビューをサポートするために、疑わしいセグメントはセグメント レベルでマークされます。

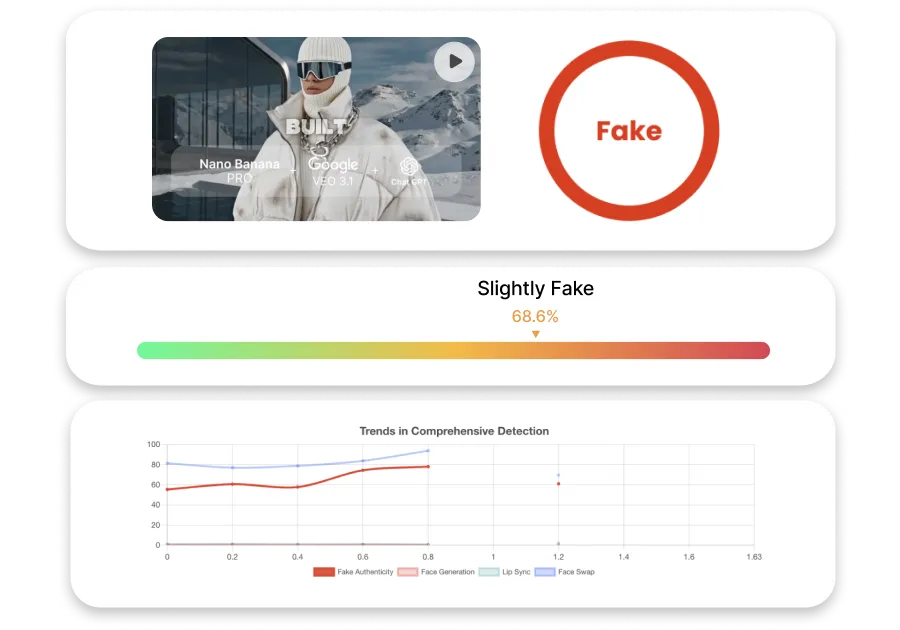

AI Detector は、証拠レポートとともに真正性の結果を提供します。レポートには、不審セグメントのタイムライン、操作の種類、検証に必要な分析スコアが含まれます。これは、調査、内部レビュー、リスク対応にすぐに使用できるようにフォーマットされています。

AI Detector は現在、90% 以上の検出精度を達成しています。主要なディープフェイク タイプ全体で安定したパフォーマンスを維持するために、継続的にアップグレードされています。継続的なデータとモデルの更新により、時間の経過とともに精度が向上します。

AI Detector は通常、数分以内に真正性の結果を提供します。ビデオ、画像、音声を迅速に処理して、調査と検証の所要時間を短縮します。疑わしいセグメントは 2 番目/セグメント レベルで強調表示され、迅速に検査できます。

AI Detector は現在、事前ブロックではなく、迅速な検出と証拠の提供に重点を置いています。コンテンツを自動削除する代わりに、責任ある当事者が行動を起こせるように明確な証拠を提供します。導入のニーズに応じて、運用ポリシーとワークフローの統合について議論できます。

はい。 AI Detector は、企業および機関環境向けの API/統合オプションを提供できます。これは、既存の検証、監視、セキュリティのワークフローに適合します。統合の範囲と方法はオンボーディング プロセス中に調整されます。

AI Detector は、顧客のセキュリティおよびプライバシー ポリシーに従って動作します。データの処理と保持の標準は、環境要件に合わせて調整できます。エンタープライズ グレードのセキュリティ制御は、組織内での展開に利用できます。

このページ内の【1ヶ月無料サポートお申込み】ボタンよりお申込みください。目的と分析範囲を確認した後、弊社担当者から次のステップについてご連絡させていただきます。当社は、公的機関、教育、企業環境全体にわたる検証リクエストをサポートします。