Защитите свое цифровое пространство с помощью онлайн-детектора DeepBrain AI Deepfake Detector, предназначенного для быстрой и точной идентификации контента, созданного искусственным интеллектом, за считанные минуты.

Легко распознавайте продвинутые дипфейковые видео, которые сложно обнаружить невооруженным глазом.

Инструмент идентификации DeepBrain AI, основанный на передовых алгоритмах глубокого обучения, анализирует различные элементы видеоконтента, чтобы эффективно различать и обнаруживать различные типы манипуляций с синтетическими медиафайлами.

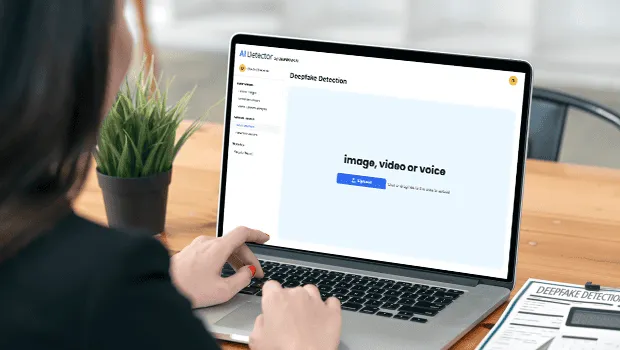

Загрузите свое видео, и наш искусственный интеллект быстро проанализирует его и в течение пяти минут проведет точную оценку, чтобы определить, было ли оно создано с использованием технологии deepfake или AI.

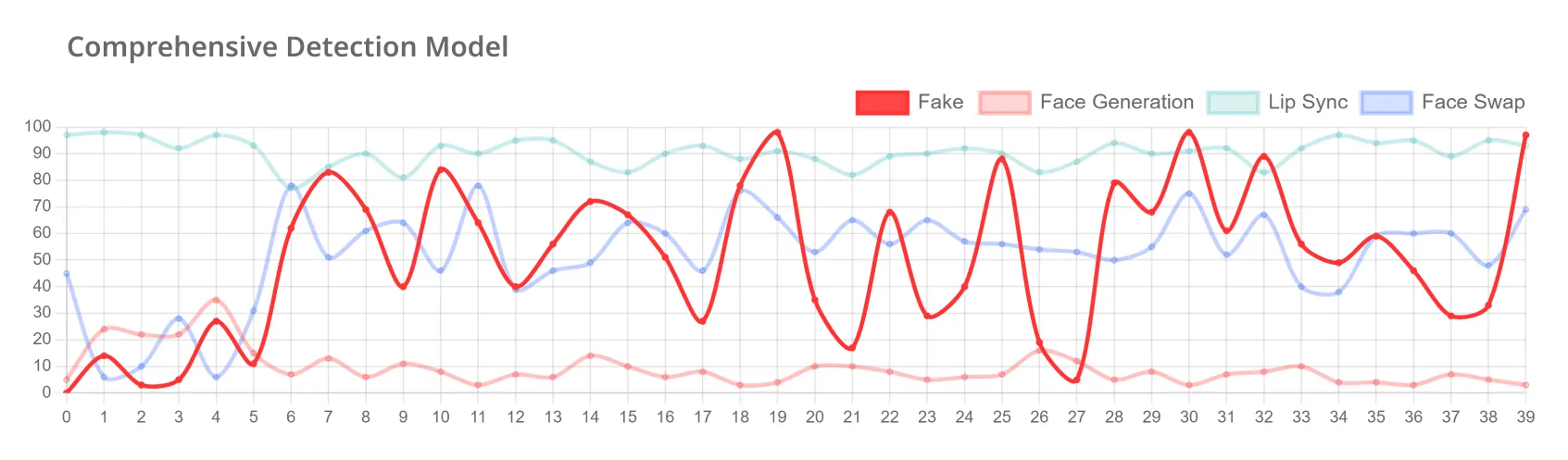

Мы точно обнаруживаем различные формы дипфейка, такие как обмен лицами, синхронизация губ и видео, созданные искусственным интеллектом, и гарантируем вам подлинный и заслуживающий доверия контент.

Быстро и точно обнаруживайте измененные видео и медиафайлы для защиты от широкого спектра преступлений, связанных с дипфейком. Решение DeepBrain AI для обнаружения помогает предотвратить мошенничество, кражу личных данных, личную эксплуатацию и кампании по дезинформации.

Мы постоянно совершенствуем наши технологии для борьбы с дипфейками, защиты уязвимых групп и предоставления действенной информации о борьбе с цифровой эксплуатацией. Мы стремимся предоставить организациям возможность эффективно защищать цифровую целостность.

Мы предоставляем наши решения и сотрудничаем с правоохранительными органами, в том числе с Национальным полицейским агентством Южной Кореи, для улучшения нашего программного обеспечения для обнаружения дипфейков для более быстрого реагирования на связанные с этим преступления.

DeepBrain AI был выбран Министерством науки и ИКТ Южной Кореи для руководства проектом «Deepfake Manipulation Video AI Data» в сотрудничестве с Исследовательской лабораторией искусственного интеллекта Сеульского национального университета (DASIL).

Мы предоставляем компаниям, государственным учреждениям и образовательным учреждениям бесплатную демонстрационную версию в течение одного месяца для борьбы с преступлениями, связанными с использованием видео, создаваемых искусственным интеллектом, и расширения их возможностей реагирования.

Ознакомьтесь с разделом часто задаваемых вопросов, чтобы получить быстрые ответы на вопросы о нашем решении по обнаружению дипфейков.

Дипфейк — это синтетические медиа, созданные с использованием искусственного интеллекта и методов машинного обучения. Обычно это манипулирование или создание визуального и звукового контента, чтобы создать впечатление, будто человек сказал или сделал что-то, чего он не сказал на самом деле. Дипфейки могут варьироваться от смены лица на видео до изображений или голосов, полностью созданных искусственным интеллектом, которые с высокой степенью реалистичности имитируют реальных людей.

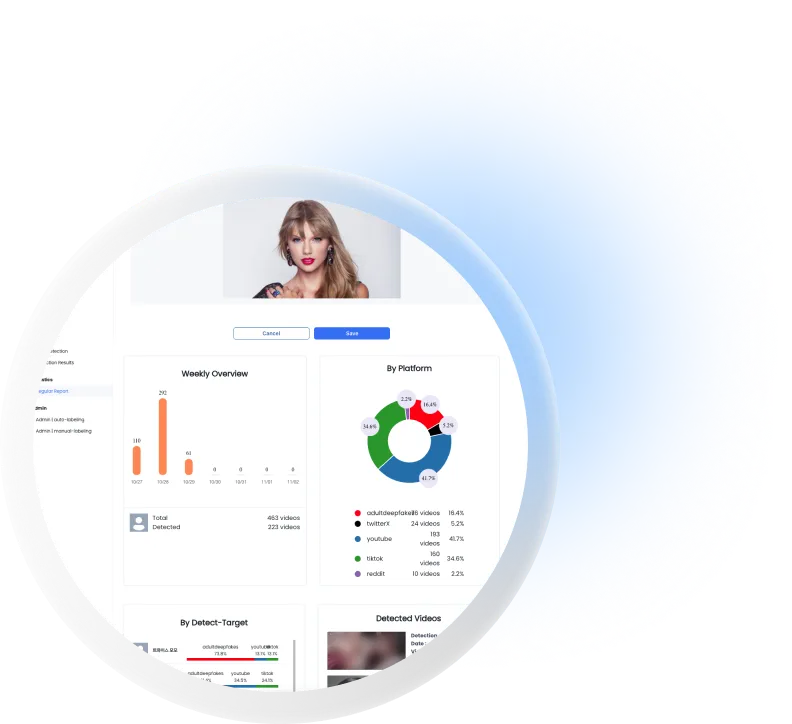

Решение DeepBrain AI для обнаружения дипфейков предназначено для выявления и фильтрации поддельного контента, созданного искусственным интеллектом. Он может выявлять различные типы дипфейков, включая обмен лицами, синхронизацию губ и видеоролики, созданные искусственным интеллектом и компьютером. Система работает путем сравнения подозрительного контента с оригинальными данными для проверки подлинности. Эта технология помогает предотвратить потенциальный вред от дипфейков и способствует уголовным расследованиям. Решение DeepBrain AI, позволяющее быстро маркировать искусственный контент, призвано защитить отдельных лиц и организации от угроз, связанных с дипфейками.

Каждая система обнаружения дипфейков использует разные методы для выявления измененного контента. Процесс обнаружения дипфейков в DeepBrain AI использует многоэтапный метод проверки подлинности:

Этот многоэтапный подход позволяет DeepBrain AI тщательно анализировать видео, изображения и аудио, чтобы определить, являются ли они подлинными или искусственно созданными.

Точность технологии обнаружения дипфейков DeepBrain AI меняется по мере развития технологии, но обычно она обнаруживает дипфейки с точностью более 90%. По мере того как компания продолжает совершенствовать свои технологии, эта точность продолжает расти.

Текущее решение DeepBrain AI для дипфейков ориентировано на быстрое обнаружение, а не на упреждающую блокировку. Система быстро анализирует видео, изображения и аудио и обычно дает результаты в течение 5—10 минут. Она классифицирует контент как «настоящий» или «поддельный» и предоставляет данные о частоте изменений и типах синтеза.

Решение, направленное на снижение вреда, не удаляет и не блокирует контент автоматически, а уведомляет соответствующие стороны, такие как модераторы контента или лица, обеспокоенные тем, что они выдают себя за дипфейка. Ответственность за действия несут эти стороны, а не DeepBrain AI.

DeepBrain AI активно работает с другими организациями и компаниями, чтобы сделать возможной упреждающую блокировку. На данный момент решения компании по обнаружению помогают выявлять подозрительный контент и расследовать поддельные дипфейковые видеоролики, чтобы еще больше снизить вред.

Крупные технологические компании активно реагируют на проблему дипфейков посредством совместных инициатив, направленных на снижение рисков, связанных с вводящим в заблуждение контентом на основе искусственного интеллекта. Недавно на Мюнхенской конференции по безопасности они подписали «Техническое соглашение по борьбе с мошенническим использованием искусственного интеллекта на выборах 2024 года». Это соглашение обязывает такие компании, как Microsoft, Google и Meta, разрабатывать технологии обнаружения и противодействия вводящему в заблуждение контенту, особенно в контексте выборов. Они также разрабатывают передовые методы цифровых водяных знаков для аутентификации контента, созданного искусственным интеллектом, и сотрудничают с правительствами и академическими учреждениями в продвижении этичных методов искусственного интеллекта. Кроме того, компании постоянно обновляют свои алгоритмы обнаружения и повышают осведомленность общественности об опасностях дипфейков с помощью образовательных кампаний, демонстрируя твердую приверженность решению этой новой проблемы.

В то время как крупные технологические компании добиваются успехов в борьбе с дипфейками, их усилий может оказаться недостаточно. Из-за огромного количества контента в социальных сетях практически невозможно выявить все случаи манипулирования СМИ, а более сложные дипфейки могут оставаться незамеченными в течение длительного времени.

Для частных лиц и организаций, нуждающихся в дополнительной защите, специализированные решения, такие как DeepBrain AI, обеспечивают ценный уровень безопасности. Постоянно анализируя интернет-СМИ и отслеживая конкретных людей, DeepBrain AI помогает снизить риски, связанные с дипфейками. Таким образом, хотя отраслевые инициативы и важны, для эффективного решения проблемы дипфейков необходим многогранный подход, включающий специализированные инструменты и информирование общественности.